Coding Agents werden zum wichtigsten KI-Interface und Codex könnte OpenAIs Super App werden

Die Kommandozeile entwickelt sich gerade zur produktivsten Art, mit KI zu arbeiten. OpenAI stellt Sora ein, benennt seine Produkt-Abteilung in "AGI Deployment" um und baut Codex mit Plugins, Skills und App-Integrationen zur Plattform aus. Anthropic liefert mit Claude Code Desktop-Use und Auto-Mode nach. ElevenLabs macht Voice Agents per CLI erstellbar. Gleichzeitig treiben Tesla, Figure und Neura Robotics die Hardware voran, die diese Agents künftig steuern werden. Hier ist die Einordnung — und warum Coding Agents jetzt den entscheidenden Unterschied machen.

Warum OpenAI Sora opfert: Der wahre Plan hinter Codex

OpenAI hat Sora vollständig deaktiviert. Auf den ersten Blick ein Rückzug. Doch dahinter steckt eine klare Strategie.

Die Produkt-Abteilung unter Fidji Simo heißt jetzt "AGI Deployment". Das ehemalige Sora-Team arbeitet an Weltmodellen — besonders relevant für Robotik. Und ein neues Modell mit dem Codenamen Sput (vermutlich GPT 5.5 oder GPT 6) ist in Arbeit.

Der eigentliche Shift: Compute, das bisher für KI-generierte Videos verbrannt wurde, fließt jetzt in LLMs, AGI-Forschung und vor allem in Codex. Sam Altman liebäugelte schon 2015 mit einer Super App nach dem Vorbild von WeChat. Codex könnte genau das werden. Die Plattform vereint CLI, Plugins, Skills und App-Integrationen. Das ist kein Coding-Tool mehr. Das ist ein Betriebssystem für KI-Agents.

Codex Plugins: Skills, Apps und MCP-Server in einem Paket

OpenAI rollt Plugins für Codex aus. Plugins bündeln Skills, Apps und MCP-Server. Bereits verfügbar: Slack, Figma, Canva, GitHub, Gmail, Google Drive, Notion, Sentry und Stripe. Jede Integration liefert dedizierte Fähigkeiten — Slack etwa fasst Channel-Konversationen zusammen.

OpenAIs eigene Empfehlung macht die Strategie klar: Skills für Experimente, Plugins fürs Team. Skills eignen sich für individuelle Workflows. Plugins standardisieren diese Workflows über Projekte und Abteilungen hinweg. Das ist der zentrale Use Case für jede Corporate-LLM-Strategie.

Plugins lassen sich über die Codex App und das CLI nutzen. Auch eigene Plugins lassen sich erstellen — analog zu Cloud-Code-Skills. Die Parallelen sind kein Zufall. Beide Plattformen konvergieren zum gleichen Paradigma: Coding Agents als primäres Interface.

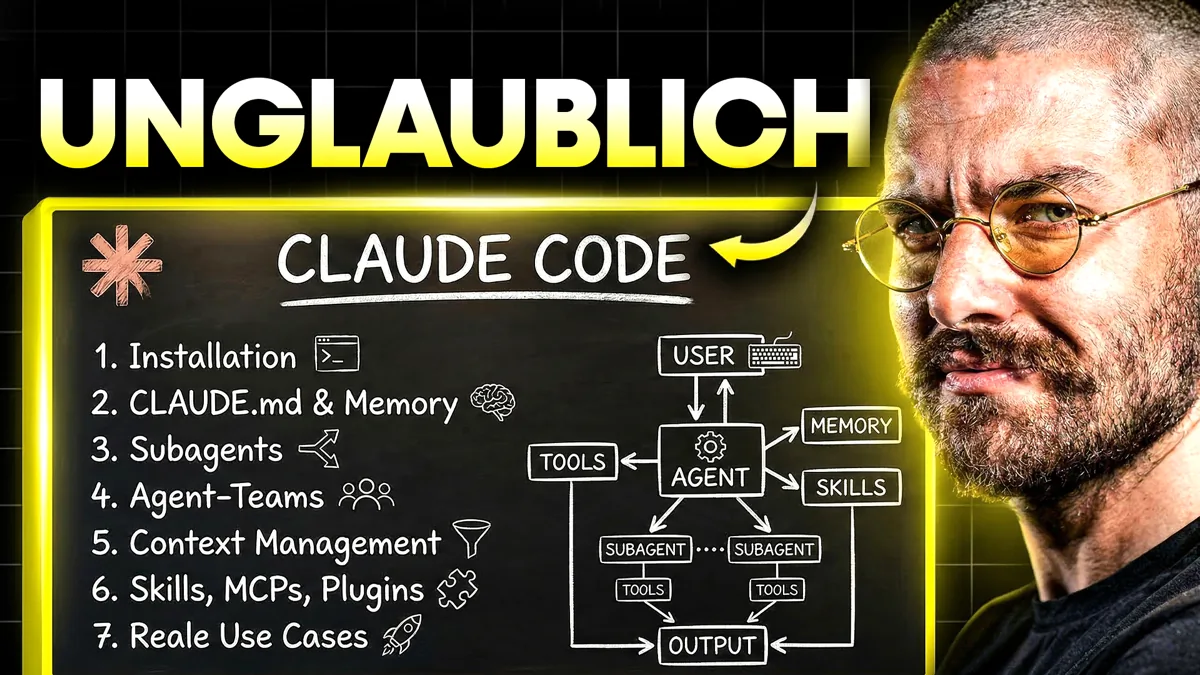

Claude Code: Auto-Mode, Desktop-Use und Apps

Anthropic zieht mit. Claude Code integriert jetzt Apps wie Figma-Designs, Canvas-Slides und Dashboards direkt in der mobilen App. Drei Neuerungen stechen heraus.

Desktop-Use funktioniert jetzt zuverlässig. Coding Agents steuern lokale Anwendungen, klicken durch Oberflächen und setzen komplexe Workflows um. Browser-Use-Agents sind schon erstaunlich gut. Desktop-Use zieht nach. Angekündigt ist auch Phone-Use — Claude Code soll bald das gesamte Smartphone bedienen.

Die wichtigste Neuerung für den Alltag: der Auto-Mode. Er löst ein echtes Problem. Der normale Permission-Mode erfordert ständige Bestätigung. "Dangerously Skip Permissions" ist zu riskant. Der Auto-Mode findet die Mitte. Jeder Tool-Call läuft durch einen Klassifizierer. Sichere Aktionen werden automatisch bestätigt. Riskante blockiert. Aktivieren per claude enable auto-mode. Wer die bisherigen Entwicklungen nachvollziehen will, findet alle Cloud-Code-Updates im Überblick in unserem Artikel.

ElevenLabs CLI: Voice Agents per Coding Agent erstellen

ElevenLabs CLI zeigt, wohin die Reise geht. Voice Agents lassen sich jetzt direkt über Coding Agents wie Claude Code erstellen. Kein manuelles Klicken in Web-Oberflächen. Kein Zusammenstecken von Workflows per Drag-and-Drop.

Im Test erstellte Claude Code einen vollständigen Inbound-Agent: System-Prompt, Knowledge Base aus der Unternehmens-Website, Intent-Erkennung, Workflow-Routing mit Sub-Agents für Lead-Qualifizierung, Terminbuchung und Projekt-Status. Noch nicht perfekt. Aber ein klarer Durchbruch für schnelle MVPs.

Das Muster ist eindeutig. Niemand wird in zwei bis drei Jahren noch in UIs Linien verbinden und Prompts eintippen. Die Erstellung von Agents — ob Voice, Chat oder Desktop — läuft über CLIs und Coding Agents. Wer sich jetzt auf eine Sache fokussieren sollte, dann genau diese.

Die Hardware-Seite: Optimus Gen 3, Terafab und Neura Robotics

Coding Agents brauchen nicht nur Software. Sie brauchen Hardware, die in der realen Welt agiert. Und hier passiert gerade ebenso viel.

Tesla Optimus Gen 3 bringt Hände mit 22 Freiheitsgraden — doppelt so viele wie Gen 2. Dazu 50 Aktuatoren analog zur menschlichen Anatomie und taktile Drucksensoren in den Fingerkuppen. Feinmotorik galt als größte Hürde. Tesla schließt diese Lücke. Wer tiefer einsteigen will, findet in unserem Guide zu humanoiden Robotern die technischen Hintergründe.

Terafab liefert das Compute. Die Chip-Fabrik als Joint Venture von Tesla, SpaceX und xAI plant auf 9,3 Millionen Quadratmetern Chips mit 1 Terawatt Leistung pro Jahr — das 50-Fache der gesamten globalen KI-Chip-Produktion. 80 Prozent davon fließen in orbitale Rechenzentren, angetrieben durch Solarenergie.

Neura Robotics aus Metzingen schließt eine Runde von knapp einer Milliarde Euro ab. Bewertung: 4 Milliarden Euro. Entscheidend: Neura baut mit der TU München das Robo-Gym — das weltweit größte Roboter-Trainings-Center. Denn das wahre Problem humanoider Roboter sind nicht Motoren oder Sensoren. Es sind fehlende Trainings-Daten.

Figure 03 lief im Weißen Haus über den roten Teppich und begrüßte Delegierte aus 45 Nationen in 11 Sprachen. CEO Brad Adcock gründet parallel HARC — ein KI-Lab mit 100 Millionen Dollar für eigene Hardware, agentische Software und Weltmodelle.

Claude Mythos und ARC AGI 3: Modelle und Benchmarks

Zwei weitere Signale verdienen Beachtung.

Auf einer nicht veröffentlichten Anthropic-Unterseite tauchte Claude Mythos auf. Laut Leak: "by far das mächtigste KI-Modell, das wir jemals deployed haben." Eine neue Klasse, größer als Opus. Anthropic stuft es als erhebliches Cyber-Security-Risiko ein. Ob Opus 5 oder etwas anderes — die nächste Modell-Generation steht bevor.

ARC AGI 3 setzt KI-Modelle auf unter 1 Prozent zurück. Menschen erreichen 100 Prozent. Kurz nach Release meldet das Agentica SDK bereits 36 Prozent — als Agent-Framework, nicht als einzelnes Modell. Das unterstreicht den zentralen Trend: Nicht Modelle allein bringen Durchbrüche. Es ist der Harness drumherum. Genau deshalb gewinnen Coding Agents gerade so stark an Bedeutung.

Fazit: Die Kommandozeile wird zum Betriebssystem für KI

Codex Plugins, Claude Code Auto-Mode, ElevenLabs CLI — die produktivste Art, mit KI zu arbeiten, verlagert sich in die Kommandozeile. OpenAI opfert Sora und baut Codex zur Plattform aus. Anthropic liefert mit Desktop-Use und Auto-Mode nach. Und die Hardware von Tesla, Neura und Figure schafft die physische Infrastruktur, die Coding Agents künftig steuern. Wer jetzt lernt, mit diesen Tools zu arbeiten, baut sich einen Vorsprung auf, der sich nicht mehr einholen lässt.

.png)

.webp)

.webp)

.webp)

.webp)