GPT-5.5 „Spud" knackt DAS Problem von Claude! ImageGen 2, Claude Design & mehr KI-News

OpenAI veröffentlicht mit GPT 5.5 den ersten komplett neuen Pretrain seit fast zwei Jahren. Anthropic gesteht öffentlich Performance-Probleme bei Claude Code ein. Aus China drängen Kimi K2.6 und DeepSeek V4 als Open-Source-Antworten auf den Markt. Dieser Artikel ordnet die wichtigsten KI-Updates der Woche ein und zeigt, was für deinen Arbeitsalltag wirklich zählt.

Anthropic Cowork: Live Artefakte als Mini-Apps mit MCP-Zugriff

Anthropic launcht in Claude Cowork die sogenannten Live Artefakte. Damit baust du per Prompt eine kleine Web-App, die direkt auf deine Echtzeitdaten zugreift. Die Verbindung läuft über MCP-Server wie SharePoint, Google Drive oder Slack.

Ein konkretes Beispiel aus unserer Praxis: ein Live-Branchen-Dashboard mit kategorisierten News, Lesezeichen-Funktion und manueller Suche. Claude wählt den passenden MCP-Server selbst aus und liefert ein funktionsfähiges Mini-Tool. Das Artefakt bleibt in deinem Workspace gespeichert und lässt sich jederzeit erneut starten.

Wichtig vor dem Start: aktiviere unter Fähigkeiten den Web-Zugriff. Sonst kann Claude in der Sandbox-Umgebung von Cowork keine Quellen abrufen.

Parallel veröffentlicht Anthropic in der Preview Claude Design. Die App baut UI-Entwürfe, Slides und One-Pager auf Basis von Opus 4.7. Figma reagierte mit einem Intraday-Kursminus von rund 7 Prozent. In der Praxis stößt du jedoch nach wenigen Iterationen auf das Nutzungslimit. Selbst auf dem Max-Plan für 200 Dollar im Monat berichten Entwickler von Rate-Limits nach 20 Prompts.

Claude Code unter Druck: Anthropic gesteht drei Bugs ein

Wer seit Anfang April 2026 intensiv mit Claude Code gearbeitet hat, spürte den Qualitätsverlust. Anthropic bestätigt drei gestapelte Fehler. Ein heruntergedrehter Reasoning-Effort, eine fehlerhafte Cache-Optimierung und ein falscher Wort-Deckel trafen exakt den Launch von Opus 4.7.

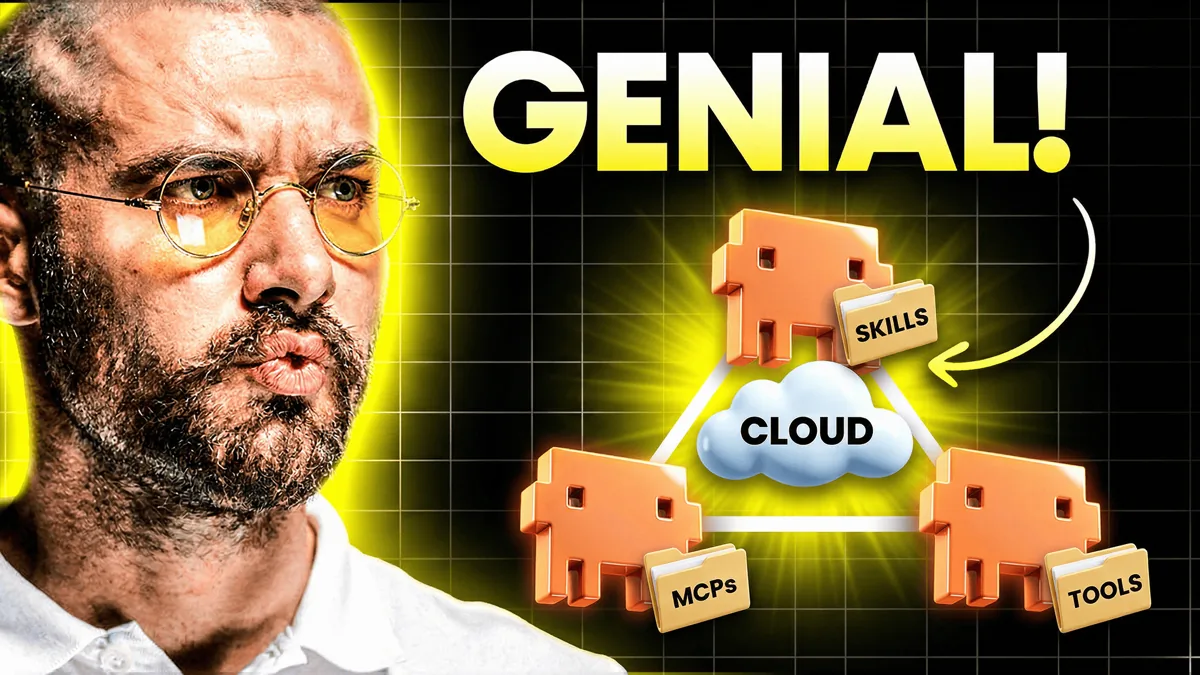

Die Konsequenz: Anthropic setzt zum Wochenende alle Rate-Limits für Subscriber zurück. Zusätzlich zeigen Leaks, dass du in Cowork bald eigene Modelle anbinden kannst, etwa über Open Router. Das bestätigt die Compute-Knappheit. Wir haben sie bereits im versteckten Problem hinter dem Opus 4.7 Update ausführlich beleuchtet.

Anthropic sichert sich diese Woche fünf weitere Gigawatt Rechenleistung über Amazon. Das entspricht grob fünf Atomkraftwerken und über 100 Milliarden Dollar Commitment an AWS im kommenden Jahrzehnt. Über eine Million Trainium-2-Chips sind im Einsatz. Ein weiteres Gigawatt mit Trainium 3 folgt bis Jahresende.

Trotz aller Kritik bleibt Opus 4.7 in vielen Bereichen das stärkste Modell für echte Wissensarbeit. Wir nutzen es weiter täglich. Du solltest die Ankündigung trotzdem ernst nehmen: deine Performance hängt direkt von Anthropics Hardware-Strategie ab.

GPT 5.5: Der erste neue Pretrain seit zwei Jahren

OpenAI positioniert GPT 5.5 explizit nicht als besseren Chatbot. Das Modell soll Aufgaben am Computer eigenständig zu Ende bringen. Computer-Use und Browser-Use sind erstmals als eigene Kernfähigkeit gelistet.

Das Besondere: GPT 5.5 ist der erste vollständig neue Pretrain seit GPT-4 aus dem Jahr 2024. Die gesamte 5er-Reihe baute auf derselben Basis auf. Updates erfolgten nur durch Post-Training. Der neue Trainingslauf fand auf einem 100.000er-GB200-Cluster im Stargate-Rechenzentrum in Texas statt.

Auf Terminal Bench 2.0, einem realitätsnahen Test für Coding-Agents, erreicht GPT 5.5 satte 82,7 Prozent. Claude Opus 4.7 liegt bei 69,4 Prozent, Gemini 3.1 Pro bei 86,5 Prozent. Das ist die erste klare Coding-Führung von OpenAI seit Monaten.

Noch wichtiger ist der Sprung beim Long-Context. Auf dem MRCR-Benchmark prüft OpenAI, ob Modelle bei einer Million Token noch zuverlässig Informationen finden. GPT 5.5 erreicht 74 Prozent, GPT 5.4 nur 36 Prozent, Opus 4.7 magere 32 Prozent.

Konkret bedeutet das: du kannst eine komplette Codebase, ein Vertragswerk oder Dutzende Dokumente auf einmal einspeisen. Auch eine Information auf Seite 400 taucht im Denkprozess noch auf. Genau hier scheiterten die meisten Modelle bisher.

GPT 5.5 vs Claude Opus 4.7: Wer gewinnt in der Praxis?

Wir haben beide Modelle in einer realen Aufgabe getestet. Aufgabe: ein einminütiges Marketing-Video für die Voice-Dictation-App Voicely, gebaut mit Remotion. Opus 4.7 lief im High Effort, GPT 5.5 im Extra High Effort.

Opus 4.7 war minimal schneller fertig. Designtechnisch lieferte Opus zudem das deutlich rundere Ergebnis. GPT 5.5 produzierte unnötige Textelemente und wirkte überladen. Für marketing-lastige Kreativaufgaben bleibt Opus unsere erste Wahl.

GPT 5.5 spielt seine Stärken anderswo aus. Die neue Codex-App erstellt aus einem einzigen Prompt eine komplette PDF-Analyse mit Charts und sogar eine PowerPoint-Präsentation. Beides nativ, ohne Drittanbieter-Tools. Für strukturierte Recherche-Outputs ist das ein echter Sprung.

Bei den Kosten lohnt der Blick auf den Cost-to-Run-Index von Artificial Analysis. Opus 4.7 kostet rund 5.000 Dollar, GPT 5.5 nur 3.357 Dollar. Der Grund: GPT 5.5 verbraucht deutlich weniger Reasoning-Token bei vergleichbarer Qualität. Wer viel Volumen fährt, spart hier konkret. Die Detailfrage Codex versus Claude Code haben wir im Artikel über die Agentic-Coding-Super-Apps tiefer ausgeleuchtet.

GPT Image 2: Realismus auf neuem Niveau

Mit GPT Image 2 liefert OpenAI das neue führende Bildmodell. Auf der Text-to-Image Arena schlägt es Nano Banana Pro von Google um 242 Punkte. Sam Altman vergleicht den Sprung mit GPT-3 zu GPT-5.

Die spürbaren Unterschiede in der Praxis:

- Realismus: iPhone-Schnappschüsse wirken so echt, dass selbst geübte Augen den KI-Ursprung nicht erkennen.

- Text-Rendering: komplexe Schriftarten und gemischte Sprachen wie Thai oder Japanisch werden sauber wiedergegeben.

- Beliebige Seitenverhältnisse: Format-Vorgaben kommen direkt in den Prompt.

- Bessere Prompt-Treue: das Modell denkt explizit nach, bevor es generiert.

Ein konkreter Business-Case aus unserem Test. Lade eine fotolose Speisekarte hoch und frage ein Rebranding mit Foodfotos zu jedem Gericht an. Image 2 lieferte eine ready-to-use-Karte beim ersten Versuch. Nano Banana 2 erkannte mehrere Gerichte falsch und erzeugte den typischen KI-Look.

Auch Branding-Aufgaben funktionieren: aus einem Smartphone-Foto eines Kokosöls baute das Modell vier minimalistische Ad-Slides. Ohne Branding-Vorgaben, ohne mehrfache Iteration. Im kostenlosen ChatGPT-Plan generierst du drei bis vier Bilder, in den bezahlten Plänen deutlich mehr. Auflösung bis 2K.

China antwortet: Kimi K2.6 und DeepSeek V4 als Open Source

Während alle auf OpenAI und Anthropic schauen, drücken zwei chinesische Open-Source-Modelle den Preis. Kimi K2.6 von Moonshot landet auf der Design Arena auf Platz 1. Das Modell schlägt dort Opus 4.7 und Opus 4.6. Es ist das erste chinesische Modell, das Anthropic die Designkrone abnimmt.

Auf SWE-Bench Pro, dem Test für echte GitHub-Issues, erreicht Kimi 58 Prozent. Das ist exakt der Wert von GPT 5.5. Das Modell hält in einem Lauf bis zu 4.000 Tool-Aufrufe und 12 Stunden Dauerbetrieb durch. Die autonome Plattform OpenCla läuft bereits darauf.

Einen Tag später folgt DeepSeek V4. Die Pro-Variante kommt mit 1,6 Billionen Parametern, die Flash-Variante mit 284 Milliarden. Beide bieten ein Kontextfenster von einer Million Token. DeepSeek selbst spricht von der Ära des bezahlbaren Millionen-Kontextes.

Der Haken: lokal lauffähig sind diese Modelle für die wenigsten. Selbst aggressiv quantisiert frisst DeepSeek V4 Pro mehrere hundert Gigabyte VRAM. Die Praxis läuft über die offiziellen APIs oder europäische Open-Source-Hoster. Für Corporate-LLM-Projekte mit Datensouveränitäts-Anforderung ist das eine echte Option.

Bildung und Robotik: Zwei deutsche Chancen, die wir nicht verpassen sollten

Der Spiegel titelte im April 2026 "Macht uns KI dumm". Der Artikel zeichnet ein defizitorientiertes Bild von KI in der Schule. Felix Urban lehrt an einer der prämierten KI-Schulen Deutschlands. Seine Einordnung: viele Kollegen verbieten KI reflexhaft, statt sie als Innovationsmotor zu begreifen.

Seine Schule geht den umgekehrten Weg. Schüler entwickeln im KI-Führerschein eigene Apps, manche denken inzwischen über Unternehmensgründungen nach. Die Botschaft: ein Land, das nur Kompetenzen zu bieten hat, muss KI-Kompetenz aktiv aufbauen. Nicht trotz, sondern wegen der Risiken.

Auch in der Robotik öffnet sich ein deutsches Fenster. OpenAI bekennt sich öffentlich zum Aufbau humanoider Roboter. Laut Sam Altman fehlt aber selbst die Fähigkeit, einen einzigen Aktuator zu bauen. Genau diese kompakten Aktuatoren sind die unterschätzte deutsche Chance.

Schaeffler gewann diese Woche einen Award für Aktuatoren in humanoiden Robotern. Neura schließt einen neuen Pakt mit Amazon. Wer in Deutschland Hardware-Komponenten baut, sollte den Robotik-Markt jetzt strategisch prüfen.

Fazit: GPT 5.5 verändert die Karten, ersetzt Opus 4.7 aber nicht

Die Woche markiert einen Wendepunkt. GPT 5.5 liefert echte Substanz: besseres Long-Context-Verhalten, klare Coding-Führung, höhere Token-Effizienz. Es ist der erste neue Pretrain seit zwei Jahren. Für Recherche, Datenanalyse und große Dokumente ist es ab sofort die erste Wahl.

Claude Opus 4.7 bleibt für Design-, Marketing- und Wissensarbeit unsere Empfehlung. Anthropic kommuniziert die Bugs offen. Der ausgeweitete AWS-Deal zeigt: das Unternehmen nimmt die Compute-Knappheit ernst.

Die strategische Lehre für Unternehmen: setze nicht auf ein einzelnes Modell. Nutze Codex für strukturierte Outputs, Claude Code für tiefe Wissensarbeit, Kimi oder DeepSeek für preissensitive Open-Source-Workflows. Wer 2026 wettbewerbsfähig bleiben will, baut sein KI-Setup multipolar auf.

.png)