Die großen KI-Tools liefern im März 2026 bedeutende Updates. Claude bekommt Inline-Visualisierungen und Code Review. Microsoft baut Copilot Cowork auf Anthropics Technologie. ChatGPT erhält Skills und einen interaktiven Lernmodus. Google launcht das erste multimodale Embedding-Modell. Dazu kommt Fish Audio S2 als neues Open-Source-Werkzeug für Sprachsynthese. In diesem Artikel erfährst du, welche KI-Tool-Updates dich jetzt betreffen – mit konkreten Funktionen, Preisen und Praxis-Einschätzungen.

Claude Update: Inline-Visualisierungen schlagen ChatGPTs Lernmodus

Das größte Claude Update im März 2026 betrifft die visuellen Fähigkeiten. Anthropic aktiviert Inline-Visualisierungen in der Beta. Du findest die Funktion in den Einstellungen unter „Fähigkeiten". Einmal aktiviert, erstellt Claude interaktive Grafiken direkt im Chat.

Ein Beispiel: Du forderst ein neuronales Netz mit drei Layern an. Claude liefert eine funktionierende, klickbare Darstellung. Gewichte lassen sich in Echtzeit anpassen. Die Verbindungslinien reagieren sofort. Du kannst Biases neu initialisieren oder einzelne Werte von Hand justieren.

Technisch generiert Claude HTML, SVG und JavaScript on the fly. Das Ergebnis lässt sich herunterladen, kopieren und weiter bearbeiten. Diese Funktion steht für jedes Thema bereit: Business, Technik, Kreativarbeit oder Bildung. Es gibt keine Beschränkung auf vordefinierte Konzepte.

ChatGPT Update: Interaktiver Lernmodus und seine Grenzen

OpenAI kontert mit einem eigenen ChatGPT Update: dem interaktiven Lernmodus. Nutzer erhalten visuelle Erklärungen statt reiner Textantworten. Die Funktion ist bereits im kostenlosen Plan verfügbar. Schreibe etwa „Hilf mir den Satz des Pythagoras zu verstehen" – und ChatGPT zeigt eine interaktive Demo.

Doch das Tool hat klare Grenzen. OpenAI beschränkt die Funktion auf rund 70 vordefinierte MINT-Konzepte auf Highschool- und College-Niveau. Individuelle Themen lassen sich nicht visualisieren. Wer exponentielles Wachstum anhand der Zinseszins-Formel darstellen will, erhält stattdessen einen Code-Schnipsel – der nicht einmal fehlerfrei läuft.

Der Unterschied liegt in der Architektur. ChatGPT nutzt eine proprietäre Widget-Engine, vermutlich auf React- und Canvas-Basis. Die Widgets sind fest integriert und geben keinen sichtbaren Code aus. Claude dagegen erzeugt den Code dynamisch und stellt ihn zum Download bereit.

Für den direkten Vergleich: Claudes Ansatz ist unbegrenzt und flexibel. ChatGPTs Ansatz ist begrenzt, aber für Schüler mit Standard-MINT-Themen durchaus nützlich. Langfristig erscheint Anthropics Methode skalierbarer – denn bessere Modelle erzeugen automatisch bessere Visualisierungen.

Copilot Cowork Update: Microsoft setzt auf Anthropics Claude

Microsoft stellte am 9. März 2026 Copilot Cowork vor. Die Funktion erinnert nicht zufällig an Claude Cowork von Anthropic. Sie basiert tatsächlich auf derselben Technologie. Microsoft bestätigt die enge Zusammenarbeit mit Anthropic.

Copilot Cowork verwandelt eine einfache Anweisung in einen mehrstufigen Plan. Der Agent arbeitet im Hintergrund. Er greift auf E-Mails, Meetings, Dateien und Kalender zu. Zwischenergebnisse prüfst du über klare Checkpoints. Du behältst die Kontrolle und gibst einzelne Schritte frei.

Dieses Update wirft Fragen auf. Microsoft hat über 13 Milliarden Dollar in OpenAI investiert. Trotzdem setzt der Konzern bei seinem wichtigsten Produktivitäts-Feature auf Anthropics Modell. Jared Spataro, Microsofts KI-Marketingchef, erklärt den Kurswechsel so: Copilot sei „modelldivers by Design". Das beste Modell bekommt den Job – egal, wer es gebaut hat.

Für Unternehmen im Microsoft-Ökosystem ist das relevant. Copilot Cowork läuft in der Cloud innerhalb des eigenen Microsoft-365-Tenants. Alle Aktionen unterliegen den bestehenden Sicherheits- und Compliance-Regeln. Claude Cowork dagegen arbeitet lokal auf dem Desktop. Beide Ansätze haben Stärken – je nach Anforderung.

Die Lizenz kostet 30 Dollar pro Nutzer und Monat. Das neue E7-Bundle mit Copilot, Agent 365 und allen Sicherheitstools liegt bei 99 Dollar. Copilot Cowork befindet sich aktuell in einer Research Preview. Breiterer Zugang folgt über das Frontier-Programm.

Das bestätigt einen Trend, den viele Experten seit Monaten betonen: Corporate LLMs, also zentrale KI-Plattformen im Unternehmen mit mehreren Modellen und DSGVO-Konformität, sind der richtige Weg. Wer sich für diesen Ansatz interessiert, findet auf kiberatung.de eine umfassende Einführung zu Corporate LLMs.

Gemini Update: Embedding 2 vereint alle Medientypen

Google veröffentlichte mit Gemini Embedding 2 das erste nativ multimodale Embedding-Modell. Es bildet Text, Bilder, Videos, Audio und Dokumente in einem einzigen Vektorraum ab. Das gab es bisher so nicht.

Bisherige Embedding-Modelle arbeiteten fast ausschließlich mit Text. Wolltest du eine Video-Bibliothek durchsuchen, musste die KI das Video zuerst transkribieren. Dann erst konnte sie den Text einbetten. Dieser Umweg kostete Zeit und ging auf Kosten der Genauigkeit.

Gemini Embedding 2 verarbeitet alle Medientypen direkt. Du kannst ein Foto eines Oldtimers zusammen mit der Frage „Welcher Motortyp ist das?" in einer einzigen Anfrage senden. Das Modell behandelt beides als ein gemeinsames Konzept. Es versteht Audio als Schallwelle und Video als Bewegung – ohne Umweg über Text.

Die technischen Eckdaten überzeugen. Das Modell erzeugt 3.072-dimensionale Vektoren und unterstützt über 100 Sprachen. Es akzeptiert bis zu 8.192 Token an Texteingabe, sechs Bilder pro Anfrage, 120 Sekunden Video und native Audio-Daten. Die Matryoshka-Technik erlaubt es, die Dimensionen flexibel zu skalieren – auf 1.536 oder 768 – ohne spürbaren Qualitätsverlust.

In der Praxis zeigt sich der Vorteil bei Retrieval-Augmented Generation (RAG). Ein Ersatzteilkatalog als PDF lässt sich indexieren. Die KI extrahiert alle Teile, legt sie als Embedding ab und findet auf Anfrage das passende Bauteil mit Preis und Wahrscheinlichkeit. Das funktioniert auch mit Bildern: Sechs Fotos hochladen, nach einem Tier fragen – und das System liefert das richtige Ergebnis.

Für Unternehmen mit großen Datenbeständen ist das ein Durchbruch. Produktkataloge, technische Zeichnungen, Schulungsvideos und Audiodateien wandern in denselben Suchindex. Separate Systeme für Bilder und Text fallen weg. Die Latenz sinkt laut frühen Nutzern um bis zu 70 Prozent.

Ein konkretes Beispiel aus der Rechtsbranche: Everlaw, ein Legal-Tech-Anbieter, setzt Gemini Embedding 2 für die Dokumenten-Analyse in Gerichtsverfahren ein. Die multimodale Suche verbessert Präzision und Recall über Millionen von Datensätzen hinweg – und ermöglicht erstmals eine leistungsstarke Bild- und Videosuche in juristischen Akten.

Gemini Embedding 2 ist aktuell als Public Preview über die Gemini API und Vertex AI verfügbar. Entwickler können das Modell auch über LangChain, LlamaIndex, Weaviate, ChromaDB und weitere Frameworks nutzen.

KI-Wissensmanagement: Der entscheidende Wettbewerbsfaktor

Die meisten KI-Projekte scheitern nicht an der Technik. Sie scheitern an den Daten. Wer seine Unternehmensdaten nicht für KI-Agenten optimiert, verschenkt Potenzial.

Oliver Trabert, Gründer von Octonomy AI, bringt es auf den Punkt. Sein Unternehmen hat gerade eine 20-Millionen-Dollar-Seedrunde abgeschlossen und beschäftigt 70 Mitarbeiter in Köln, Denver und New York. Octonomy fokussiert sich auf komplexes Wissensmanagement – und erreicht dabei eine Antwortgenauigkeit von 95 Prozent. Der Branchendurchschnitt liegt bei 50 Prozent.

Der Unterschied liegt im Ansatz. Klassische RAG-Systeme extrahieren Text aus PDFs, zerschneiden ihn in Chunks und legen diese in einer Vektordatenbank ab. Bei diesem Prozess gehen alle visuellen Informationen verloren: Tabellen, Grafiken, hydraulische Pläne, elektrische Schaltbilder.

Octonomy arbeitet visuell. Ihr System orientiert sich am menschlichen visuellen Cortex. Es erkennt verschiedene Bereiche auf einer Seite – Fließtext, Tabelle, Graph – und verbindet das Gesehene mit der Bedeutung. Ein fotografisches Gedächtnis merkt sich, wo welche Information steht. Mitarbeiter von Stability AI und Aleph Alpha bringen das nötige Know-how ein.

Traberts Rat an Unternehmen: Starte nicht mit dem einfachsten Anwendungsfall. Beginne mit einem anspruchsvollen Use Case. Eine Lösung, die komplexe Daten verarbeitet, kommt auch mit einfachen Aufgaben klar. Umgekehrt funktioniert das nicht.

Das Thema Wissensmanagement verbindet sich direkt mit dem Trend zu KI-Agenten. Denn Agenten brauchen strukturierte, gut aufbereitete Daten. Das zeigt auch ein neues Projekt von Archive.org: Die Plattform stellt wissenschaftliche Paper jetzt als Markdown-Dateien bereit. Agenten verarbeiten Markdown effizienter als PDF. Es verbraucht weniger Token und liefert bessere Ergebnisse.

Wer im eigenen Unternehmen KI-Agenten aufbauen will, muss seine Dokumente entsprechend strukturieren. Genau solche Infrastrukturen beschreibt der Leitfaden zu KI-Agenten detailliert.

Figure 03: Der humanoide Roboter für den Haushalt

KI verlässt nicht nur den Bildschirm. Sie wandert auch in die physische Welt. Figure AI hat neue Fähigkeiten für seinen humanoiden Roboter Figure 03 vorgestellt. Der Roboter sortiert Gegenstände bimanuell ein: Eine Hand greift, die andere hält den Korb. Er bedient eine Sprühflasche, schaltet den Fernseher ein und ordnet Kissen.

Das Besondere: Es handelt sich nicht um teleoperierte Demos oder vorprogrammierte Abläufe. Figure 03 lernt neue Aufgaben durch einfache Beispiele aus der realen Welt. Ein einziges Modell – Helix – erfasst alle Fähigkeiten. Was ein Roboter lernt, können alle anderen sofort.

Die Zahlen hinter Figure AI sind beachtlich. Das Unternehmen schloss im September 2025 eine Milliarden-Dollar-Runde ab – bei einer Bewertung von 39 Milliarden Dollar. Nvidia, Jeff Bezos, OpenAI und Microsoft gehören zu den Investoren. Die neue Fabrik BotQ produziert bis zu 12.000 Roboter pro Jahr. In vier Jahren sollen es 100.000 sein. Der angestrebte Preis liegt bei rund 20.000 Dollar.

Figure 03 ist 1,68 Meter groß und wiegt 61 Kilogramm. Die Kameras liefern doppelt so viele Bilder pro Sekunde wie beim Vorgänger. Die Latenz sank um 25 Prozent. Das Sichtfeld wuchs um 60 Prozent. Fingerspitzensensoren erkennen drei Gramm Druck – etwa das Gewicht einer Büroklammer. Das reicht, um Gläser sicher zu greifen.

Für den Heimgebrauch trägt Figure 03 eine weiche Textilhülle mit Schaumstoffpolster. Das soll Quetschungen verhindern und den Roboter weniger maschinenhaft wirken lassen. Die kabellose Ladetechnik nutzt Spulen in den Füßen. Der Roboter tritt einfach auf eine Ladestation und lädt mit bis zu 2 kW. Eine volle Ladung reicht für rund fünf Stunden Betrieb.

CEO Brett Adcock gibt sich ambitioniert. Er erwartet, dass allgemeine Robotik innerhalb von 18 bis 24 Monaten gelöst sein könnte. Erste Heim-Einsätze plant Figure AI für Ende 2026. Noch ist der Roboter allerdings nicht frei erhältlich.

Auch in Deutschland tut sich viel. Die TU München baut gemeinsam mit Neura Robotics das weltweit größte Trainings- und Forschungszentrum für humanoide Roboter im wissenschaftlichen Bereich. David Reger von Neura Robotics betont: Der entscheidende Wettbewerbsfaktor ist nicht mehr die Mechanik. Er liegt in den Trainingsdaten. Wer hochwertige, realitätsnahe Daten besitzt, bestimmt das Tempo. Ein wichtiger Aspekt dabei: Humanoide Roboter lernen kollektiv. Was ein Roboter lernt, beherrschen alle anderen sofort – weil sie auf demselben Modell laufen. Das macht die Skalierung deutlich schneller als bei klassischen Industrierobotern.

Fish Audio S2 Update: Open-Source-Tool für Stimmenklonen

Im Bereich Text-to-Speech sorgt Fish Audio S2 für Aufsehen. Das Modell wurde mit über 10 Millionen Stunden Audio in rund 80 Sprachen trainiert. Es bietet kontrollierbare Emotionen direkt im Text. Statt globaler Einstellungen fügst du Tags wie [whisper], [laughing] oder [professional broadcast tone] an beliebiger Stelle ein.

Die Benchmark-Ergebnisse sprechen für sich. Im Audio Turing Test erreicht S2 einen Score von 0,515 – 24 Prozent besser als Seed-TTS und 33 Prozent besser als MiniMax-Speech. Im Seed-TTS-Eval erzielt es die niedrigste Fehlerrate aller getesteten Modelle, einschließlich geschlossener Systeme.

Fish Audio S2 klont Stimmen auf Basis einer 10- bis 30-sekündigen Referenzaufnahme. Der Prozess dauert etwa eine Minute. Das Ergebnis klingt verblüffend nah am Original. Die Modellgewichte, der Fine-Tuning-Code und die Inferenz-Engine sind auf GitHub und Hugging Face verfügbar.

Die Latenz liegt unter 150 Millisekunden. Das macht S2 geeignet für Echtzeit-Anwendungen: Chatbots, virtuelle Assistenten, Hörbücher oder Spielcharaktere. Auf einer einzelnen NVIDIA H200 GPU erreicht das System einen Real-Time-Faktor von 0,195.

Diese Entwicklung hat auch eine Schattenseite. Wenn jede Stimme nahezu perfekt klonbar ist, wachsen die Risiken für Betrug und Manipulation. Experten empfehlen deshalb: Vereinbare Codewörter mit Familie und engen Kontakten. So lässt sich im Zweifel prüfen, ob ein Anruf echt ist.

GenAI-Nutzerzahlen: Wer dominiert den Markt?

Aktuelle Daten von a16z zeigen ein klares Bild. ChatGPT führt bei den monatlich aktiven Nutzern unter Konsumenten weiterhin deutlich. Das gilt sowohl für die Website-Besuche der Top 50 GenAI-Plattformen als auch für die mobilen Apps.

Claude und Claude Code richten sich bewusst an Business-Anwender und Powernutzer. Anthropic optimiert seine Produkte für den Geschäftskontext. ChatGPTs Stärke liegt im breiten Konsumentenmarkt – von Bildgenerierung über Videoschnitt bis zum kreativen Experimentieren.

Auffällig: KI-gestützte Apps wie CapCut tauchen in den Rankings zunehmend auf. Das zeigt, dass generative KI sich immer tiefer in bestehende Software integriert. Die Grenzen zwischen eigenständigen KI-Tools und klassischen Anwendungen verschwimmen.

Sam Altman: Intelligenz wird zum Versorgungsgut

OpenAI-CEO Sam Altman formuliert eine klare Vision. KI-Token werden zur Handelsware – ähnlich wie Strom oder Wasser. Unternehmen kaufen Rechenleistung nach Verbrauch. Größere Modelle kosten mehr, kleinere weniger. Wer mehr Denkleistung braucht, zahlt mehr.

Altman sieht eine Zukunft, in der Intelligenz so allgegenwärtig und günstig wird, dass sie jeder nutzt. Die beste Strategie sei, den Markt mit Intelligenz zu fluten. Knappheit führe nur dazu, dass reiche Akteure bevorzugt werden – oder dass Planwirtschaft das Angebot verteilt. Beides funktioniere nicht.

Diese Einschätzung deckt sich mit dem, was Branchenexperten seit Monaten beobachten. Die Kosten für KI-Inferenz sinken rasant. Gleichzeitig steigt die Leistung der Modelle. Anthropic gründete kürzlich das Anthropic Institute, um die gesellschaftlichen Folgen dieser Entwicklung zu erforschen.

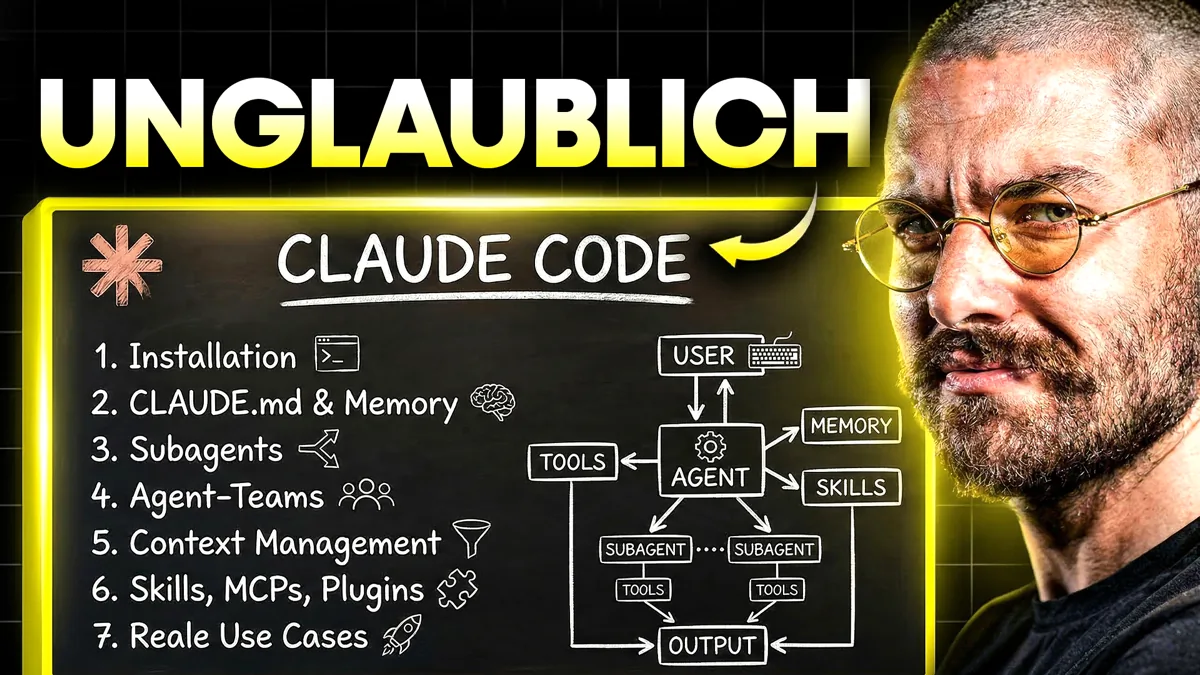

Claude Code Update: Code Review, 1M Kontextfenster und neue Befehle

Für Entwickler bleibt Claude Code das zentrale Werkzeug. Anthropic veröffentlichte im März 2026 gleich mehrere wichtige Updates. Die größte Neuerung: Claude Code Review. Dabei handelt es sich um spezialisierte Agenten, die Pull Requests prüfen und Bugs identifizieren.

Der Hintergrund: Anthropics eigener Output pro Entwickler stieg im letzten Jahr um 200 Prozent. Mehr KI-generierter Code bedeutet mehr Prüfaufwand. Code Review wurde zum Flaschenhals. Die neuen Agenten sollen diesen Engpass lösen.

Aktuell ist die Funktion allerdings nur im Teams- und Enterprise-Plan verfügbar. Pro Review fallen 15 bis 25 Dollar an. Für kleinere Teams ergibt sich der Return on Investment noch nicht.

Darüber hinaus bringt das Claude Code Update weitere spürbare Verbesserungen. Opus 4.6 erhält jetzt standardmäßig ein 1-Million-Token-Kontextfenster in den Plänen Max, Team und Enterprise. Bisher brauchte es dafür Extra-Kontingent. Der neue /loop-Befehl ermöglicht geplante Aufgaben: Tasks laufen automatisch in festgelegten Intervallen im Hintergrund. Du definierst Standard-Cron-Ausdrücke oder setzt einmalige Erinnerungen in natürlicher Sprache, etwa „Erinnere mich um 15 Uhr, den Release-Branch zu pushen."

Weitere technische Neuerungen im Detail: MCP-Elicitation-Support erlaubt es MCP-Servern, während einer Aufgabe strukturierte Eingaben anzufordern. Der neue /effort-Befehl steuert das Aufwandslevel des Modells in drei Stufen: niedrig, mittel und hoch. Worktrees unterstützen jetzt Sparse-Checkout über die Einstellung worktree.sparsePaths – ideal für große Mono-Repos, in denen nur bestimmte Verzeichnisse relevant sind.

Die mobile Claude-App erhielt ebenfalls Updates: besserer Voice-Modus mit automatischem Retry bei Verbindungsproblemen, verbesserte Transkriptionen, MCP-Konnektoren und Dokumenten-Upload. Die Integration in Excel und PowerPoint wurde dramatisch verbessert. Bestehende PowerPoint-Skills lassen sich jetzt direkt über das Cloud-Add-in verwenden. Das gilt auch für Excel. Die Add-ins teilen den vollen Kontext – jede Aktion in einer App informiert die andere.

Wer sich als Einsteiger mit dem Thema KI-gestützte Automatisierung befassen will, findet in der Ausbildung zum AI Automations Manager einen strukturierten Einstieg.

Google Workspace Update: Gemini vernetzt alle Apps

Google integriert Gemini immer tiefer in seine Workspace-Apps. Das Google Workspace Update verbindet jetzt alle Dienste nahtlos. In Google Docs referenzierst du deine E-Mails. In Google Slides greifst du auf Drive-Dokumente oder Sheets zu. Gemini kennt den Kontext über alle Apps hinweg.

Auch Google Maps profitiert vom Update. Gemini verarbeitet komplexe Anfragen wie „Finde den nächsten Ort, an dem ich mein Handy laden kann." Das System nutzt Daten von über 300 Millionen Orten und 500 Millionen Community-Beiträgen. Die neue immersive Navigation zeigt 3D-Routenansichten, intelligente Sprachführung und Echtzeit-Informationen zu Fahrspuren und Sehenswürdigkeiten. Google selbst nennt es die größte Navigationsüberarbeitung seit über einem Jahrzehnt.

ChatGPT Skills Update: Endlich wiederverwendbare Anweisungen

OpenAI rollt Skills für ChatGPT aus – eine der wichtigsten Funktionen für den produktiven Einsatz von KI-Tools. Skills erlauben es, wiederverwendbare Anweisungen zu speichern und bei jeder Konversation automatisch anzuwenden. Du definierst einmal, wie ChatGPT antworten soll – und das Tool hält sich dauerhaft daran.

Diese Funktion war bisher vor allem bei Claude bekannt und geschätzt. Dass OpenAI jetzt nachzieht, zeigt den Stellenwert von Skills im KI-Arbeitsalltag. Wer regelmäßig mit denselben Formaten, Stilen oder Fachgebieten arbeitet, spart mit Skills erheblich Zeit.

Allerdings beschränkt OpenAI den Zugang auf den Business- und Enterprise-Plan. Privatnutzer im kostenlosen oder Plus-Plan müssen warten. Das ist aus Nutzersicht schwer nachvollziehbar, da Skills gerade für Einzelnutzer enormen Mehrwert bieten.

Zusätzlich plant OpenAI, Sora nahtlos in ChatGPT zu integrieren. Künftig erstellst du Videos direkt über die ChatGPT-Oberfläche. Der Umweg über eine separate Plattform entfällt. Damit wird ChatGPT zunehmend zum multimedialen KI-Tool – nicht nur für Text, sondern auch für Bild und Video.

Fazit: Die wichtigsten KI-Tool-Updates im Überblick

Die KI-Tool-Updates im März 2026 zeigen drei klare Trends. Erstens: KI-Tools werden visuell. Claude und ChatGPT liefern interaktive Darstellungen statt reiner Textantworten. Gemini Embedding 2 versteht Bilder, Videos und Audio nativ. Reine Textantworten reichen nicht mehr aus.

Zweitens: KI-Tools werden agentisch. Copilot Cowork, Claude Code und die neuen Skills zeigen, wie KI eigenständig arbeitet. Sie planen, recherchieren und erstellen Ergebnisse – über mehrere Apps hinweg. Corporate LLMs mit mehreren integrierten Modellen werden zum Standard.

Drittens: KI-Tools erobern neue Medien. Figure 03 lernt Haushaltsaufgaben durch Beobachtung. Fish Audio S2 macht Stimmen nahezu perfekt klonbar. Die Grenze zwischen digitaler und physischer KI verschwimmt.

Für Unternehmen heißt das: Jetzt ist der Zeitpunkt, die eigene KI-Infrastruktur aufzubauen. Wissensmanagement, Datenstruktur und Agenten-Optimierung sind keine Zukunftsthemen mehr. Sie entscheiden heute über den Wettbewerbsvorteil von morgen.

Die Geschwindigkeit der Updates nimmt weiter zu. Alle 60 Tage entsteht ein neues führendes Modell. Wer zu lange wartet, gerät ins Hintertreffen. Greg Brockman, Mitgründer von OpenAI, fasst es treffend zusammen: „Wo wir hingehen, brauchen wir keine Benchmarks."

Wer den Anschluss nicht verpassen will, investiert jetzt in die richtigen Fähigkeiten und Werkzeuge. Die Technologie ist da. Die Frage ist nur, wer sie zuerst nutzt. Bleib auf dem Laufenden mit den wöchentlichen KI-News auf dem YouTube-Kanal Everlast AI – dort bekommst du jede Woche die kompakte Zusammenfassung aller relevanten KI-Tool-Updates.

.png)