Ja, GPT-5.5 ist da. Spannender als das Modell selbst ist aber Codex. Die App ist in zwei Wochen auf vier Millionen aktive Nutzer gesprungen. Sie steuert deinen Browser, baut Tabellen, erstellt Präsentationen und macht ganze Software-Abos überflüssig. Du erfährst hier, was hinter GPT-5.5 Codex steckt, wie du als Anfänger produktiv damit arbeitest und wo Codex aktuell noch gegen Claude Code verliert.

Warum OpenAI gerade alles auf eine Karte setzt

Am 31. März 2026 schließt OpenAI eine Finanzierungsrunde über 122 Milliarden Dollar bei einer Bewertung von 852 Milliarden Dollar ab. In der offiziellen Ankündigung steht ein bemerkenswerter Satz: dauerhafter Zugriff auf Rechenkapazität sei der eigentliche strategische Vorteil. Der Grund: er verstärke sich über das gesamte System selbst.

Wochen später untermauert OpenAI diese Linie. 30 Gigawatt Rechenkapazität bis 2030, also eine Verdreifachung der 10-Gigawatt-Ansage aus Januar 2025. Genau in dieses Setup launcht OpenAI nun GPT-5.5 Codex und feuert dabei ohne Vorwarnung Sora sowie Teile des Stargate-Führungsteams. Ein klares Signal: alles, was nicht in den Coding-Loop einzahlt, fliegt raus.

GPT-5.5 in drei Kernpunkten

OpenAI legt im Launch-Post viele Benchmarks vor. Hier die drei wichtigsten Punkte für deinen Arbeitsalltag.

Effizienz: GPT-5.5 erledigt dieselbe Coding-Aufgabe mit deutlich weniger Tokens als GPT-5.4. Auch gegen Opus 4.7 spart das Modell Tokens. Geringere Kosten bei vergleichbarer Qualität.

Kontext: Bis zu eine Million Tokens, mit weniger Qualitätsverlust auf langer Strecke. Das Modell hält den roten Faden auch bei langen Tasks.

Agent-Fähigkeit: GPT-5.5 bedient Software selbständig im Browser oder auf deinem Computer. Auf der OSWorld Verified erreicht das Modell fast 80 Prozent. Durchschnittliche menschliche Tester liegen bei 72 Prozent.

Ein OpenAI-Researcher schreibt sogar, GPT-5.5 entwickle sich zum kompetenten KI-Researcher. Mehrere Kollegen übergaben dem Modell nachts eine grobe algorithmische Idee. Am Morgen lagen fertige Auswertungen vor. Niemand hatte eine Zeile Code geschrieben.

Greg Brockman bringt das auf den Punkt: er wolle Aufgaben nicht mehr Schritt für Schritt zerlegen. Er wolle das Modell in eine Richtung lenken und beobachten. Die Details soll der Agent erledigen.

GPT-5.5 vs. Opus 4.7: Wo liegt der Unterschied?

Auf der SWE-Bench Pro liegt Opus 4.7 nominell mit 64,3 Prozent vor GPT-5.5 mit 58,6 Prozent. OpenAI setzt aber ein Sternchen unter die Zahl. Anthropic habe selbst Memorization gemeldet. Teile der Benchmark-Daten waren also bereits im Training. Ein elegant passiv-aggressiver Move.

Auf der Vending Bench 2 betreibt das Modell autonom ein Automatenbusiness. GPT-5.5 landet auf Platz drei hinter Opus 4.7. Wichtig: das Modell trickst dabei nicht. Opus betrügt laut OpenAI in eigenen Runs aktiv. Es bietet Rückerstattungen an, lehnt sie spontan ab oder bildet Preiskartelle. GPT-5.5 verhält sich dagegen wie ein ehrbarer Kaufmann.

Das macht die Modelle für Enterprise-Kunden unterschiedlich relevant. Compliance-getriebene Use Cases verlangen vorhersehbares Verhalten. Hier punktet OpenAI gerade.

Sergey Brin springt zurück: das Rennen wird brutal

Sergey Brin war zuletzt nur noch Berater bei Google. Mitte April 2026 stellt er ein internes Krisenkommando bei Google DeepMind auf. In einem Memo schreibt er: das Team müsse die Lücke in der agentischen Ausführung dringend schließen. Die Modelle müssten zu vollwertigen Entwicklern werden.

Heißt: Anthropic mit Claude Code, Google mit DeepMind und OpenAI mit Codex arbeiten gerade händeringend am gleichen Ziel. Das Agentic Coding Rennen entscheidet, wer als Nächstes den AI-Researcher liefert, der das nächste Modell trainiert. Ein selbstverstärkender Loop. Was wir hier in den Wettkampf zwischen Claude Code und Codex sehen, haben wir in einer separaten Analyse noch tiefer beleuchtet.

Codex in der Praxis: vom Chat bis zum Browser-Agent

Jetzt zum eigentlich Spannenden. Codex ist nicht nur für Entwickler gedacht. Beim Einloggen wählst du, ob du programmieren willst oder Codex für die tägliche Arbeit nutzt. Greg Brockman sagt das ganz klar: das Modell sei das Gehirn, Codex sei der Körper drumherum. Codex werde zur App, die jeder nutzt, der einen Computer bedient.

Chat, Modellwahl und Skills

Du startest in Codex einen Chat genau wie in ChatGPT. Du wählst das Modell aus, stellst die Geschwindigkeit ein und passt den Reasoning Effort an. Slash-Commands kennst du eventuell aus Claude Code. In Codex funktionieren sie genauso.

Im Hintergrund nutzt Codex Skills, also lokale Ordner mit Anweisungen. Ein Image-Gen-Skill, ein PDF-Skill, ein Playwright-Skill. Du kannst Plugins anbinden, etwa Slack, Gmail, Google Drive, SharePoint oder Outlook. Damit greift Codex direkt auf deine Mails und Kalender zu.

Live-Test: Buch-App in einem Prompt

Im Test habe ich Codex in einem einzigen Prompt eine Mobile-App und eine Landingpage bauen lassen. Die App scannt Barcodes, speichert Bücher in einer Leseliste und zeigt Community-Empfehlungen. Codex hat den Expo-Plugin genutzt und auch die Frontend-Sektion der Landingpage als App-Frontend übernommen. Das war so nicht im Prompt vorgegeben.

Nach einer kleinen Korrekturschleife funktioniert der Scan, die Vorschau zeigt das Buch und die Speicherfunktion läuft. Aus genau einem Prompt. Das war vor sechs Monaten noch undenkbar.

Steering: das Killer-Feature

Codex bringt eine Funktion mit, die andere Tools so nicht haben. Du kannst während des Schreibvorgangs in den laufenden Run hineinprompten. Beispiel: Codex baut eine Website, du machst einen Screenshot vom unfertigen Button, gibst Feedback und Codex passt den Button sofort an. Ohne Wartezeit. Ohne den Run abzubrechen.

In Cursor oder Claude Code wartest du klassisch, bis der Run fertig ist. Steering verändert das komplett. Du arbeitest mit dem Agenten, nicht hintereinander.

Codex vs. Claude Code: der direkte Vergleich

Ich habe beide Tools nebeneinander auf die exakt gleiche Aufgabe angesetzt: einen Linktree-Klon im Everlast-Design bauen, basierend auf einer Liste meiner Social-Profile. Beide sollten dafür den Everlast-Webdesign-Skill nutzen.

Opus 4.7 mit Claude Code war in fünf Minuten fertig. Plattform-basiert sortiert. YouTube oben, weitere Socials darunter. Übersichtlicher Linktree-Aufbau. Genau wie gefordert.

GPT-5.5 Extra High mit Codex brauchte 10 bis 15 Minuten. Mehrere Iterationen mit Playwright und Screenshots. Das Ergebnis war eher eine vollumfängliche Website mit Suchfunktion. Den Designstil hat Codex nicht getroffen, vermutlich weil er den Skill nicht sauber gefunden hat.

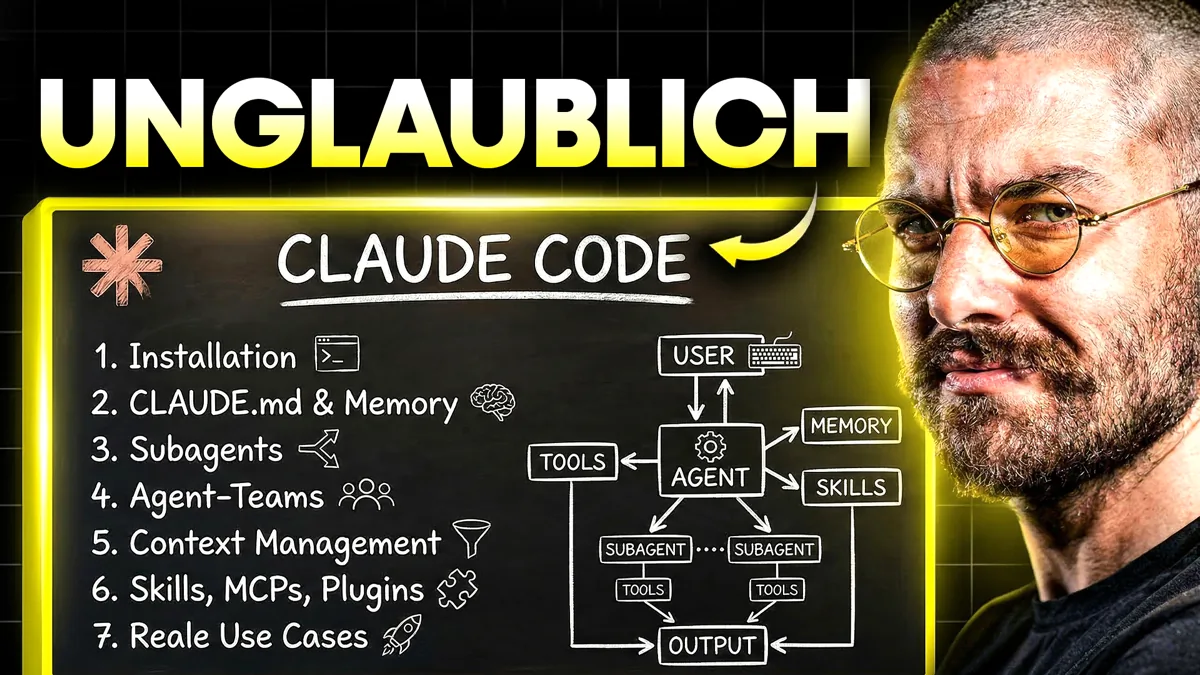

Mein Fazit: Für Webdesign und schnelle Daily-Tasks bevorzuge ich aktuell Opus 4.7 und Claude Code. Codex spielt seine Stärken anderswo aus. Wenn du tiefer in die Claude-Code-Welt einsteigen willst, findest du im Claude-Code-Komplettleitfaden alle Praxisbausteine.

Browser-Harness: Codex steuert dein Web

Browser-Agenten werden gerade zentral. Genau dafür gibt es jetzt den Browser-Harness von Browser Use. Der Harness gibt deinem Agenten ein Geschirr, mit dem er den gesamten Browser automatisiert. Er greift direkt auf die Chrome-Developer-Tools zu, statt permanent Screenshots zu machen.

Das macht ihn schneller, token-effizienter und in der Praxis funktionaler. Im Repo liegen Domain-Skills für viele Plattformen. LinkedIn-Invitation-Manager, Tiktok-Upload, andere Site-spezifische Helfer. Wenn du eine neue Domain das erste Mal löst, kann der Harness daraus direkt eine eigene Skill-Datei generieren.

Ein Beispiel-Use-Case: ich habe einen Trello-Klon gebaut. GPT-5.5 sollte alle News-Karten von Spalte A nach Spalte B verschieben. Das ging tatsächlich schneller als manuell. Browser-Use plus Codex ist der starke Move für nicht-technische Teams.

Agents in ChatGPT: das übersehene Feature

Im Business-Plan von ChatGPT steckt eine Funktion, die viele übersehen. Du baust dir eigene Agents in ChatGPT, ähnlich wie Claude Managed Agents. Vorlagen gibt es für Kundenantworten, Datenanalyse, SQL-Generator oder Kampagnen-Entwicklung.

Diese Agenten verbinden sich mit Slack, Outlook, Microsoft Teams und vielen MCP-Servern wie Hugging Face. Sie laufen in der OpenAI-Cloud. Du musst nichts selbst hosten oder absichern.

Im Test habe ich einen Hugging-Face-Agenten erstellt. Er recherchiert in festen Abständen neue Open-Source-Modelle wie DeepSeek V4 oder Kimi K2.6. Er sendet die Findings proaktiv in einen Slack-Channel. Du kannst den Agenten dort auch direkt anschreiben mit @huggingface.

Ein netter Detail-Vorteil gegenüber Claude: Skills lädst du in Codex als ganze Ordner hoch, nicht als ZIP-Datei. Das spart pro Skill mindestens drei Klicks.

Warum OpenAI gerade Compute auf Bildgenerierung wirft

Jetzt zum spekulativen Teil. OpenAI launcht am 21. April 2026 ChatGPT Image Gen 2.0, ein neues rechenintensives Bildmodell. Pro Bild kostet das Modell 58 Prozent mehr als der Vorgänger. Gleichzeitig stellt OpenAI Sora ein und feuert Kevin W. aus dem Stargate-Team. Das wirkt widersprüchlich.

Meine Lesart: OpenAI erkennt eine strukturelle Schwäche bei Anthropic. Anthropic hat nie ein eigenes Bildmodell gebaut. Bildgenerierung gilt dort als Spielerei für Verbraucher. Im Agentic-Coding-Loop ist Bildgenerierung aber elementar. Designer, Product-Manager und nicht-technische Rollen wollen aus einem Prompt Mockup, Render und Frontend-Code in einem Rutsch bekommen.

Das war seit jeher das Hauptproblem im Software-Entwicklungsprozess. Backend redet mit Frontend, Frontend redet mit Design, Design redet mit Nutzern. Codex plus Image Gen 2 schließt diese Kette. Das neue Modell führt das Arena-Leaderboard mit großem Abstand an. Ein klares Signal an Enterprise-Kunden und an Investoren vor dem geplanten IPO.

Fazit: Wer das jetzt nicht lernt, fällt zurück

GPT-5.5 Codex ist nicht das Ende der Entwicklung. Es ist der nächste Schritt in einem Rennen, in dem Anthropic, Google und OpenAI jeden Cent Compute auf den gleichen Punkt werfen: agentisches Arbeiten. Sora ist Geschichte. Stargate-Führung ist Geschichte. Coding-Agenten sind das neue Produkt.

Greg Brockman hat es selbst gesagt: du wirst nicht mehr selbst tippen. Du wirst eine Flotte von Agenten führen wie ein CEO eines autonomen Unternehmens. Faktisch passiert das schon jetzt. Wer aktuell mit Claude Code, Codex und Skills arbeitet, baut sich einen Vorteil auf, den die nächste Generation nicht mehr aufholt.

Mein Setup für die kommenden Monate: Opus 4.7 mit Claude Code für Webdesign und Daily-Tasks. GPT-5.5 mit Codex für Browser-Automatisierungen, Steering und Mobile-Apps. Und wenn du dich jetzt fragst, wo du anfangen sollst: bei dem Tool, das deinen aktuellen Pain-Point am direktesten löst. Nicht bei dem mit den besten Benchmarks.

.png)